Ollama dans Home Assistant sur Docker, donner de l’intelligence à votre domotique !

Une IA local dans Home Assistant, pourquoi ?

Pour commencer, bonjour et bienvenue sur mon blog Technologie Geek ! Voyons ensemble comment intégrer Ollama dans Home Assistant sur Docker ! Ollama est une solution innovante qui vous permet d’intégrer l’intelligence artificielle à votre configuration Home Assistant. Ensuite, Grâce à son déploiement via Docker, l’installation d’Ollama est simple, mais aussi rapide et adaptée à de nombreux environnements. Ollama utilise des modèles de langage avancés pour améliorer l’interaction avec votre maison connectée. Ces modèles d’IA fonctionnent directement en local, garantissant ainsi un haut niveau de confidentialité et de sécurité pour vos données personnelles.

Avec Ollama, vous pouvez interagir facilement avec vos appareils connectés en utilisant un langage naturel. La configuration via Docker simplifie l’intégration. En quelques étapes, vous pouvez installer et faire fonctionner Ollama dans Home Assistant sur votre système. Docker garantit également une isolation propre et un déploiement sans complications, même pour les utilisateurs qui ne sont pas experts en informatique. Cette solution apporte une nouvelle dimension à votre domotique, vous permettant de contrôler et personnaliser vos appareils d’une manière naturelle, tout en restant maître de vos données.

Que vous faut-il ?

- Premièrement, une installation d’Home Assistant sur Docker.

- Ensuite, un conteneur Ollama avec un accès à son API.

En option et si vous souhaitez utiliser la parole, vous devez disposer de Whisper et Piper ainsi qu’une connexion SSL en local à Home Assistant. Pour le moment les performances ne sont pas au rendez-vous (très lent et la reconnaissance vocal en français ne fonctionne pas correctement). De plus, l’assistant vocal demande une connexion SSL en local, ce qui obligerait à revoir toute votre installation si ce n’est pas le cas.

Configuration d’Ollama dans Home Assistant :

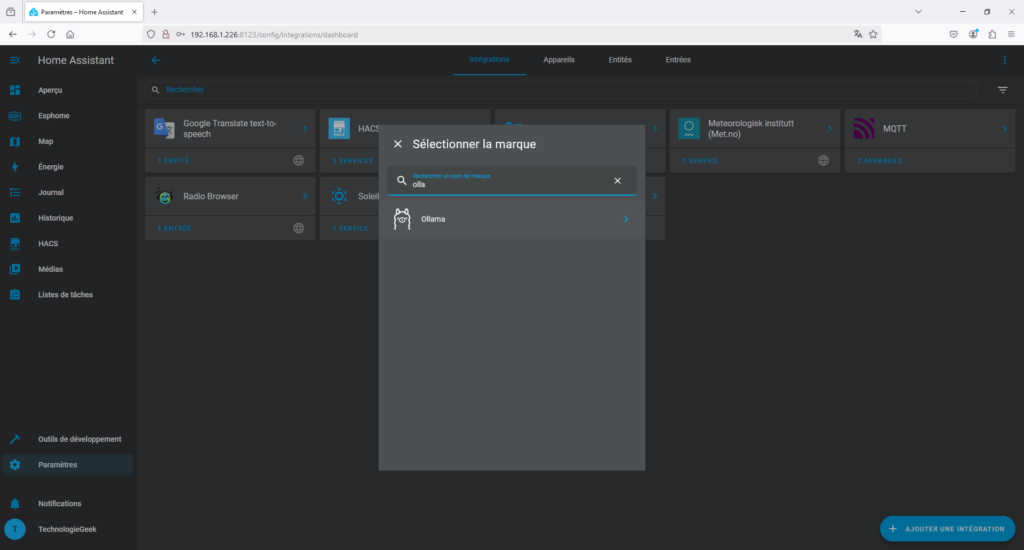

Maintenant que vos prérequis sont opérationnels et pour débuter la configuration d’Ollama dans Home Assistant sur Docker rendez-vous « Paramètres/Appareils et services ». Ensuite, cliquer sur « AJOUTER UNE INTEGRATION » et chercher Ollama.

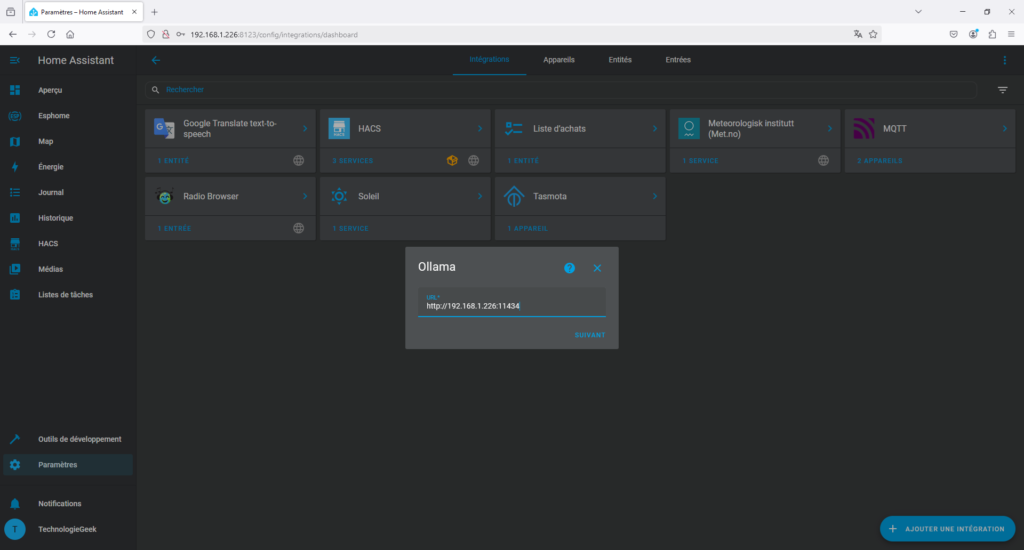

Sur l’écran suivant, vous devez entrer l’adresse IP et le port de l’API d’Ollama « http://ip-de-votre-serveur:11434 » pour ma part « http://192.168.1.226:11434 ».

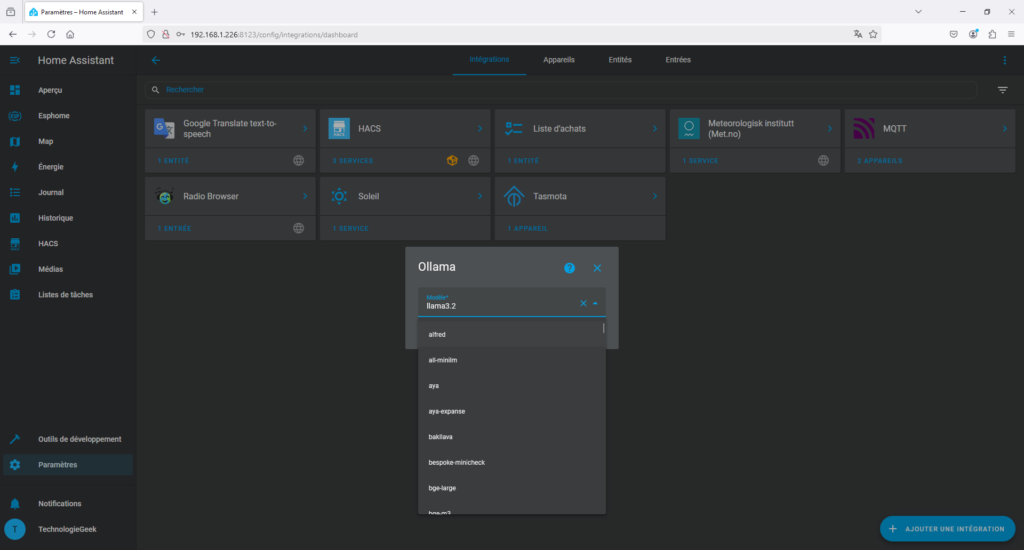

Maintenant, pour continuer le paramétrage d’Ollama dans Home Assistant sur Docker, vous devez sélectionner votre modèle de langage. Attention, certain modèle pèse plusieurs dizaines de giga ! Pour mon test, j’ai téléchargé « llama3.2 ».

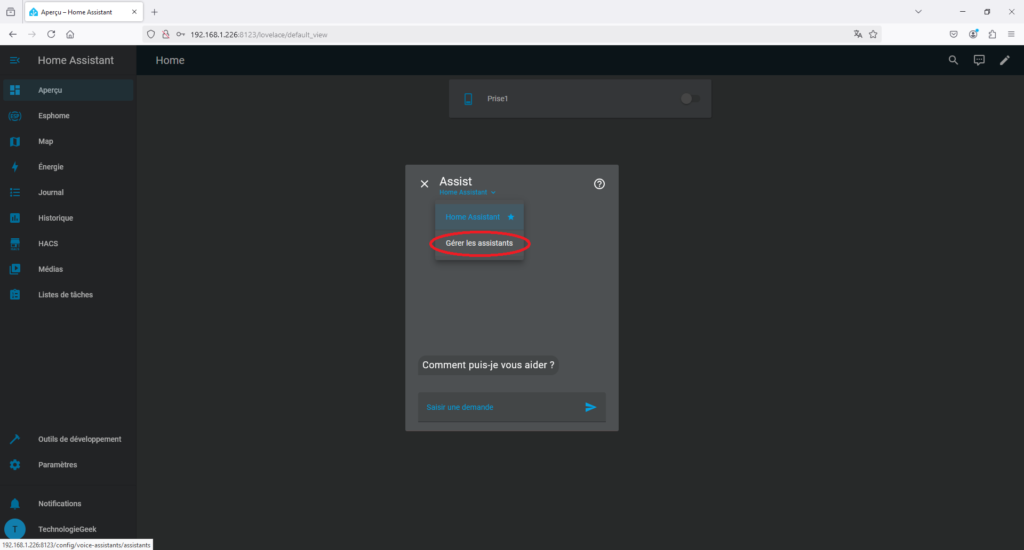

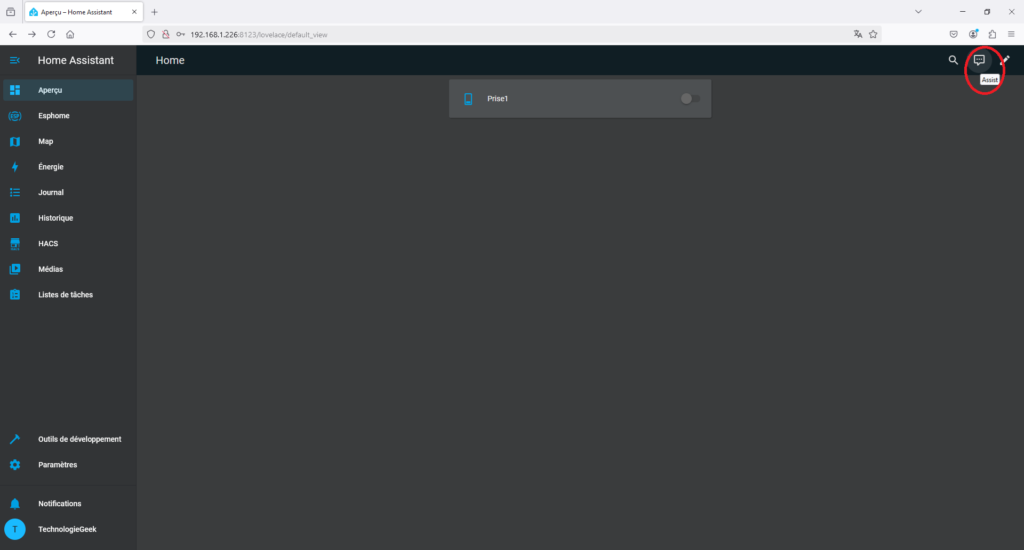

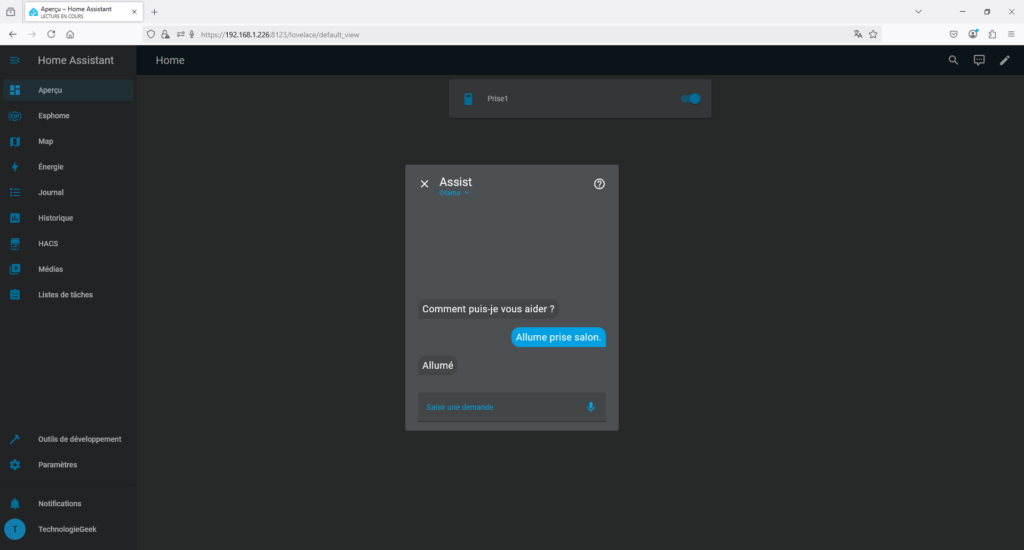

Ensuite, lorsque votre modèle est téléchargé, rendez-vous sur votre page d’accueil puis cliquer sur l’icône assistant.

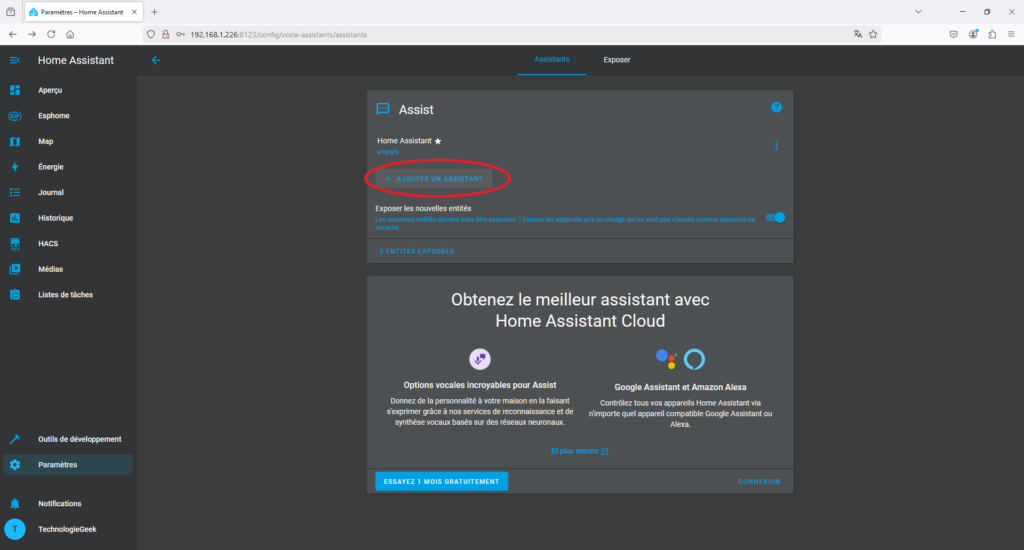

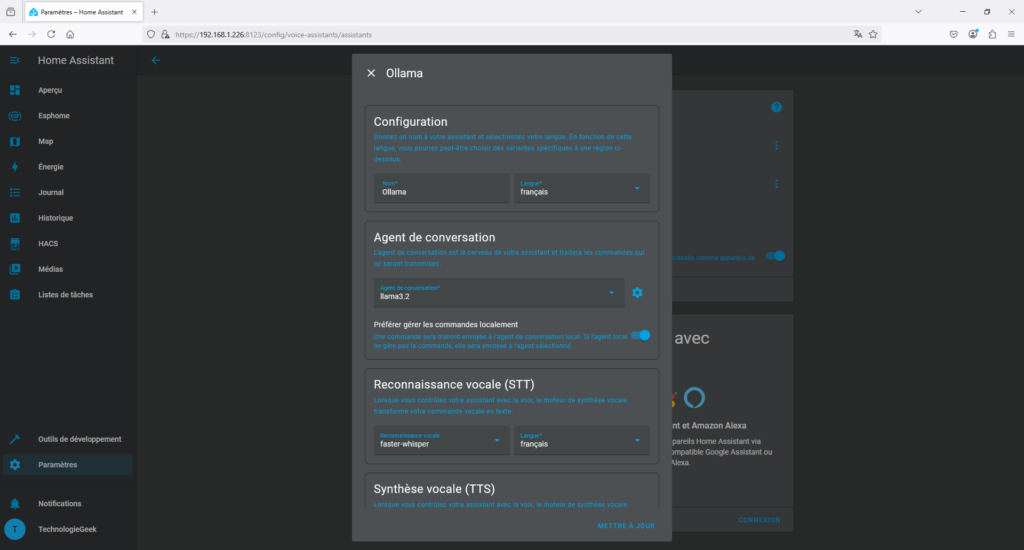

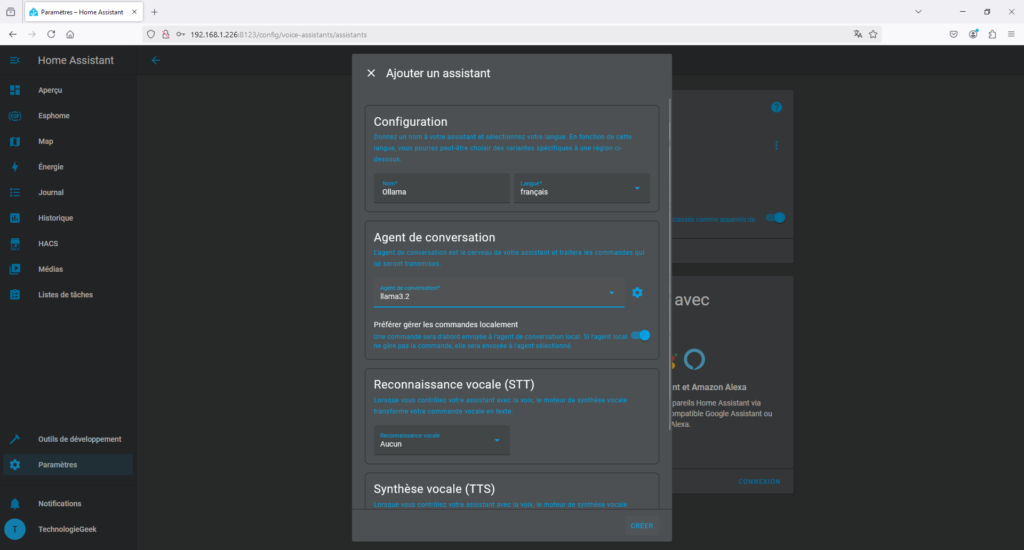

Premièrement, pour paramétrer Ollama vous devez créer un nouvel assistant. Pour cela, cliquer sur « Gérer les assistants » puis « AJOUTER UN ASSISTANT ».

Deuxièmement, il faut donner un nom à votre assistant, pour ma part se sera Ollama. Enfin, sélectionner votre agent de conversation et cliquer sur créer.

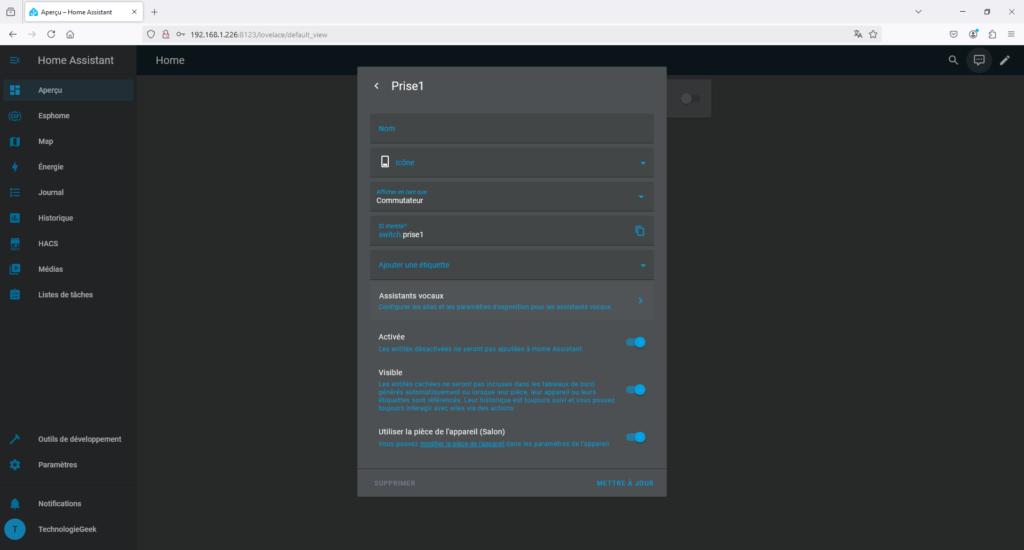

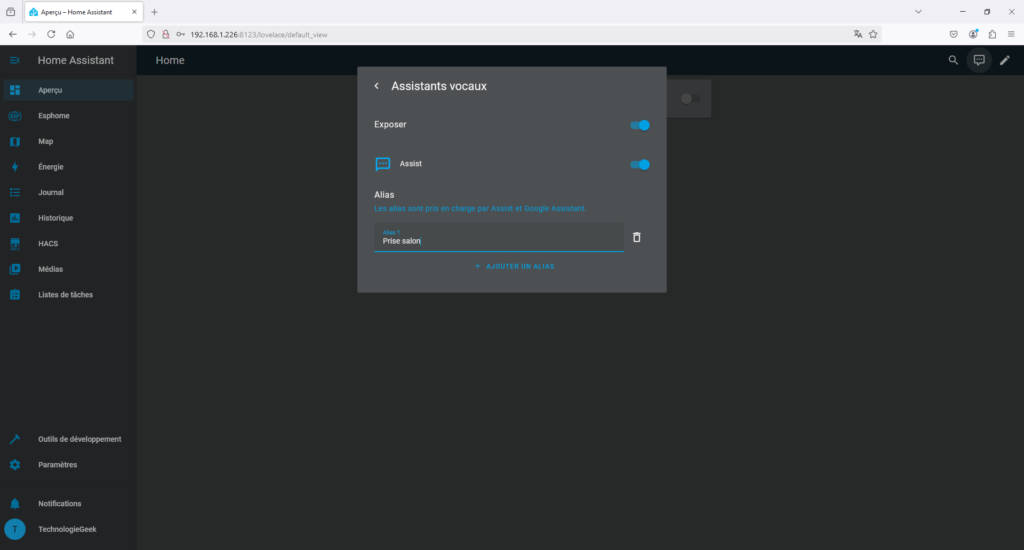

De retour sur la page d’accueil d’Home Assistant, sélectionner l’un de vos module et rendez-vous dans « Paramètres/Assistants vocaux ». Enfin, dans « Alias » vous devez lui donner un nom simple, pour ma part ce sera « Prise salon ».

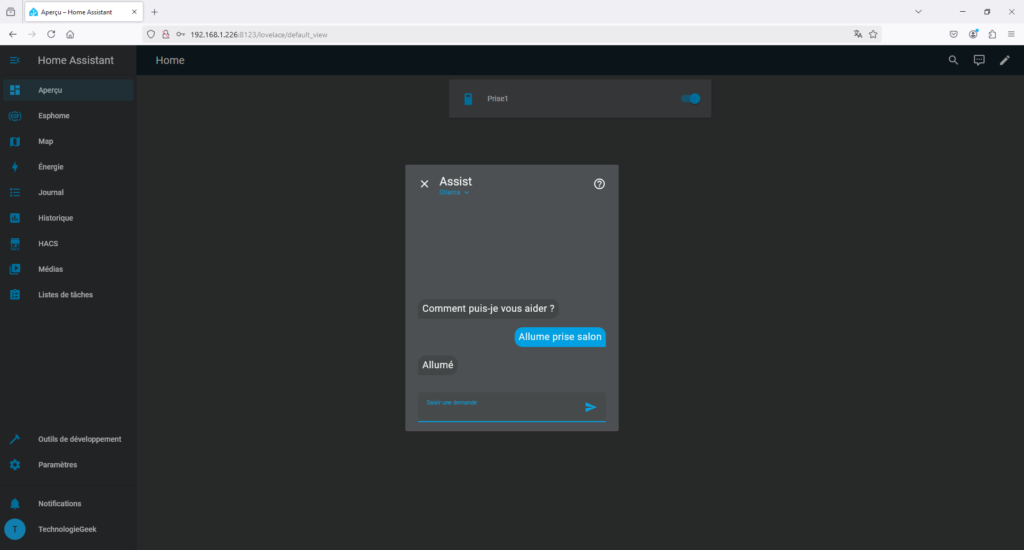

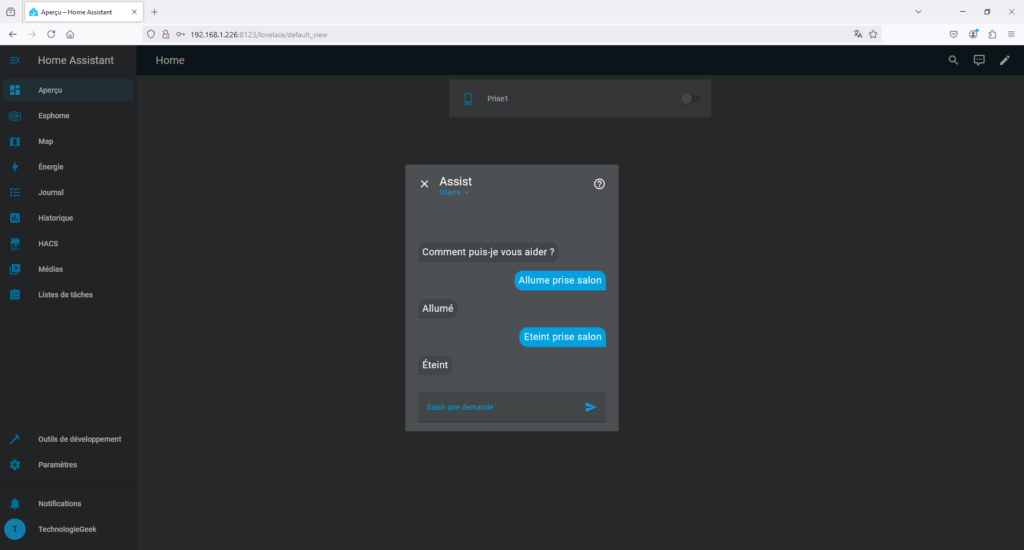

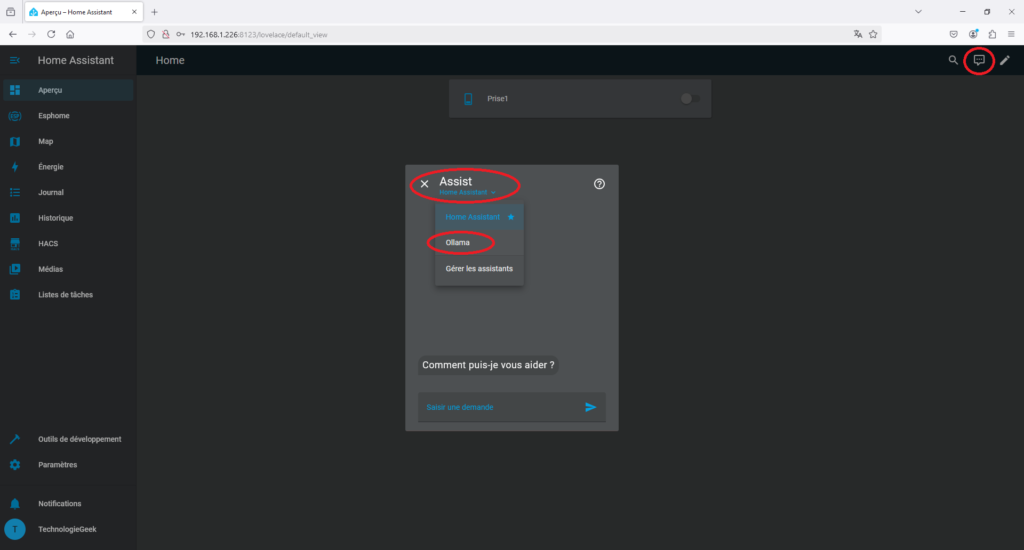

Pour terminer l’installation d’Ollama dans Home Assistant sur Docker, cliquer sur l’icône en haut à droite, ensuite sélectionner votre nouvel assistant.

Voilà, vous pouvez maintenant utiliser votre assistant Ollama en local sur Home Assistant !

Utilisation de votre assistant avec la parole :

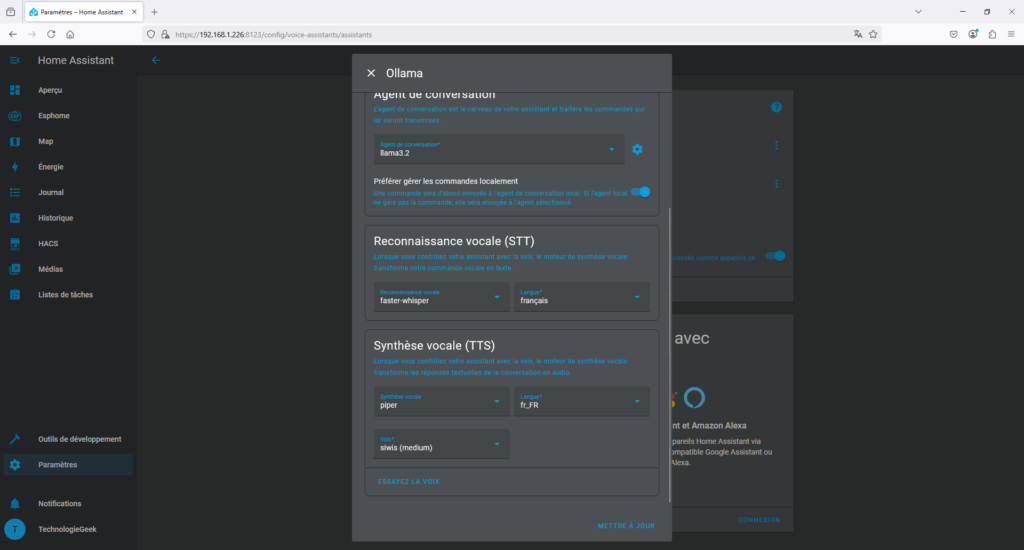

Pour commencer, je vous invite à suivre l’article Un assistant vocal intégré à Home Assistant. Ensuite, une fois Whisper et Piper opérationnel rendez-vous dans les paramètres de votre assistant :

- Premièrement, dans « Reconnaissance vocal (STT) » sélectionner « faster-whisper » et « français ».

- Deuxièmement, dans « Synthèse vocal (TTS) » sélectionner « piper » et « fr_FR ».

Pour terminer, cliquer sur le micro et parler !!!

-

Ollama dans Home Assistant sur Docker -

ESPHome sur Docker et Home Assistant -

Comment installer ioBroker sur Docker -

Home Assistant sur votre NSPanel Pro -

Flasher le NSPanel avec Tasmota et Lovelace-ui -

Un assistant vocal intégré à Home Assistant

Laisser un commentaire